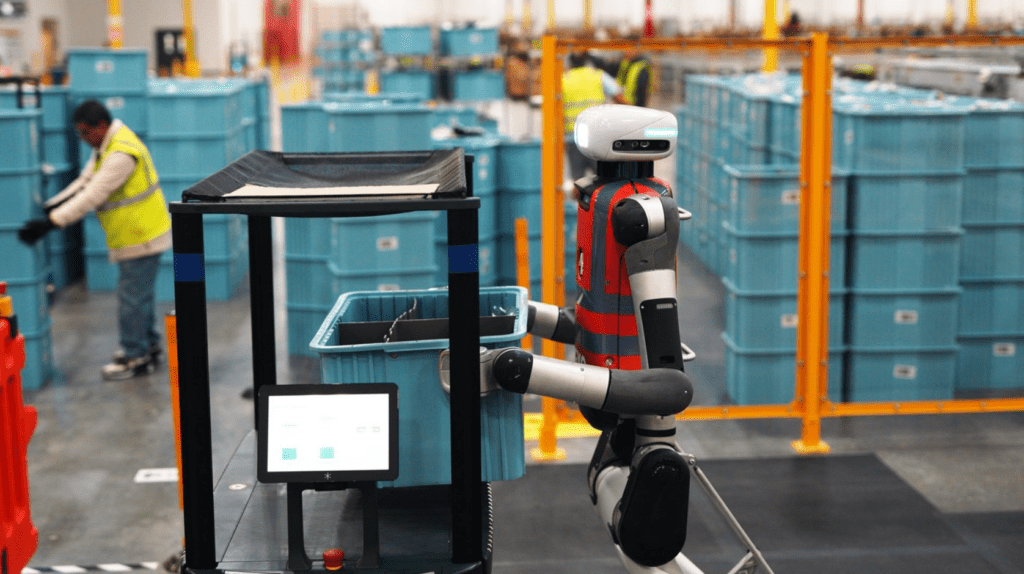

Remplacer l’humain par des robots sur les chaines de productions ennuyeuses, rebutantes et fastidieuses.

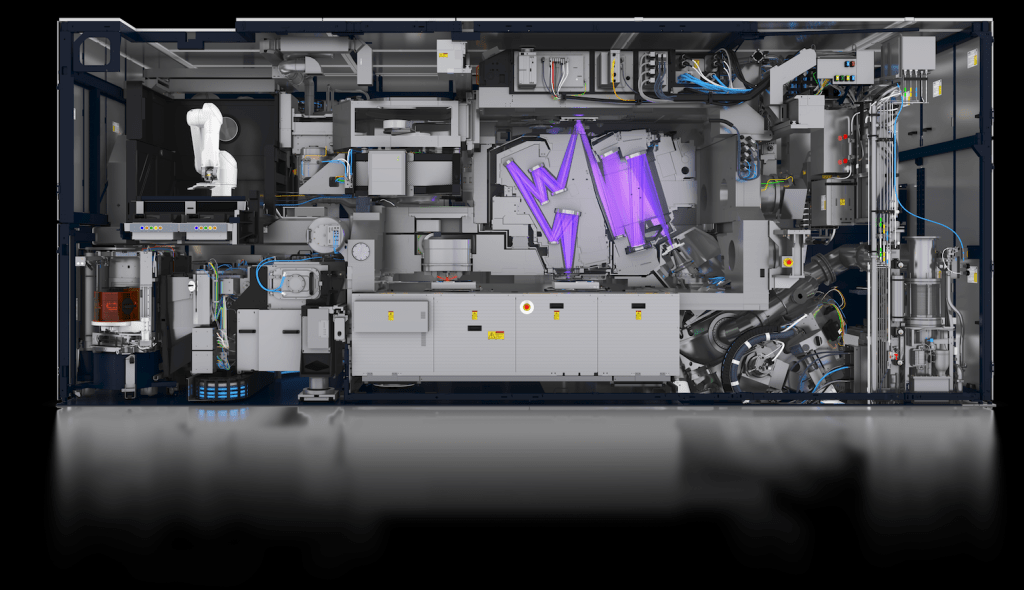

Les deux plus grand fournisseur mondial de logistique et e-commerce GXO et AMAZON ont annoncés la mise en place d’entrepôts composée de “robots ouvriers” . Cela prouve bien que ce concept centré sur l’humain appartient au passé. Des robots sont déjà en cours de test pour des tâches logistiques dans une installation GXO à Flowery Branch, en Géorgie (États-Unis), Amazon à déjà passé une commande et attend une 1ère livraison dans les entrepôts de Seattle.

/// Robot en action dans une centrale de logistique en Californie. ///

Le robot Digit, qui mesure 1m75 de hauteur, pèse 64 Kg et peut soulever jusqu’à 16 Kg. Il est conçu pour travailler dans des espaces humains et peut être facilement adapté à diverses tâches d’entrepôt grâce à des mises à jour logicielles. En effet, il sera capable de monter et descendre des marches d’escalier, de se déplacer dans des espaces restreints, et d’évoluer aux côtés des employés.

Jonathan Hurst a déclaré : “Les robots polyvalents capables de fonctionner dans des espaces humains seront une partie intégrante de notre avenir, et nous sommes ravis de travailler pour cette entreprise de logistique afin de développer notre technologie pour une application dans l’industrie de la chaîne d’approvisionnement. Il est important de noter qu’il n’est pas nécessaire de redessiner l’entrepôt ou d’installer une infrastructure au-delà de celle déjà conçue pour les personnes.” et à ajouté : “Ce programme pilote marque une autre étape majeure dans notre parcours visant à améliorer continuellement l’environnement de travail des employés tout en optimisant nos opérations grâce à des solutions technologiques innovantes.”

Le robot Digit à s’entraine à effectuer des tâches répétitives telles que le déplacement de contenants depuis des robots mobiles autonomes (AMR) et leur placement sur des convoyeurs. La réduction de cette répétition réduit la tension, augmente la sécurité pour les membres de l’équipe et les libère pour effectuer un travail à plus grande valeur ajoutée dans l’entrepôt. Une récente enquête confirme un meilleur engagement et une plus grande satisfaction au travail parmi les membres de l’équipe lorsqu’ils travaillent avec la technologie. Si cette phase initiale s’avère réussie, elle ouvrira la voie à un essai pilote de Digit dans une plus grande variété de rôles en 2024.

AMAZON va prochainement passer une commande de robots “DIGIT”

Les créateurs du robot bipède révolutionnaire Digit, ont annoncés qu’Amazon commencera à tester Digit pour une utilisation dans ses opérations.

Digit sera d’abord testé dans l’installation de recherche et développement en robotique d’Amazon, située juste au sud de Seattle. Cette évolution élargit la relation entre les deux entreprises, Agility faisant déjà partie du Fonds d’Innovation Industrielle d’Amazon.

Digit est le premier robot polyvalent centré sur l’humain conçu pour le travail logistique. Digit peut se déplacer, saisir et manipuler des articles dans des espaces et des coins d’un entrepôt de manière nouvelle. Sa taille et sa forme conviennent parfaitement aux bâtiments conçus pour les humains. Les deux entreprises estiment qu’il existe une grande opportunité de développer une solution de manipulation mobile telle que Digit, capable de collaborer avec les employés et de contribuer à la sécurité au travail.

L’utilisation initiale de Digit par Amazon consistera à aider les employés à recycler les bacs ; un processus hautement répétitif de ramassage et de déplacement des bacs vides une fois que l’inventaire a été complètement prélevé.

“Amazon est une entreprise engagée à rendre l’expérience professionnelle de ses employés plus sûre, plus facile et moins répétitive”, a déclaré Damion Shelton (co-fondateur). “Lorsque nous avons annoncé notre version la plus récente de Digit plus tôt cette année, c’est exactement le type de déploiement répétitif de manutention de matériaux auquel nous pensions ; celui qui permet aux humains d’être plus humains.”

“La taille et la forme de Digit conviennent parfaitement aux bâtiments conçus pour les humains, et nous croyons qu’il existe une grande opportunité de développer une solution de manipulation mobile”, selon Emily Vetterick, directrice de l’ingénierie d’Amazon. “Les solutions de robotique collaborative comme Digit soutiennent la sécurité au travail et aident Amazon à livrer plus rapidement aux clients, tout en créant de nouvelles opportunités et des parcours professionnels pour nos employés.”

Digit est conçu dès le départ pour aller là où vont les personnes et effectuer un travail utile, en toute sécurité, dans des espaces conçus pour les personnes. En raison de la conception centrée sur l’humain de Digit, qui s’adapte à de nombreux flux de travail humains, il offre une utilité polyvalente. Les premiers Digits seront livrés aux clients du programme de partenariat, avec une disponibilité sur le marché général prévue pour 2025.

L’ouverture d’un RoboFab à été annoncée, une usine de fabrication de robots de 70 000 pieds carrés à Salem, Oregon. Agility prévoit une capacité de production de centaines de robots Digit la première année, avec la possibilité d’atteindre plus de 10 000 robots par an. Digit travaillera également dans la nouvelle usine, de manière similaire aux sites clients d’Agility, en déplaçant, chargeant et déchargeant des bacs.

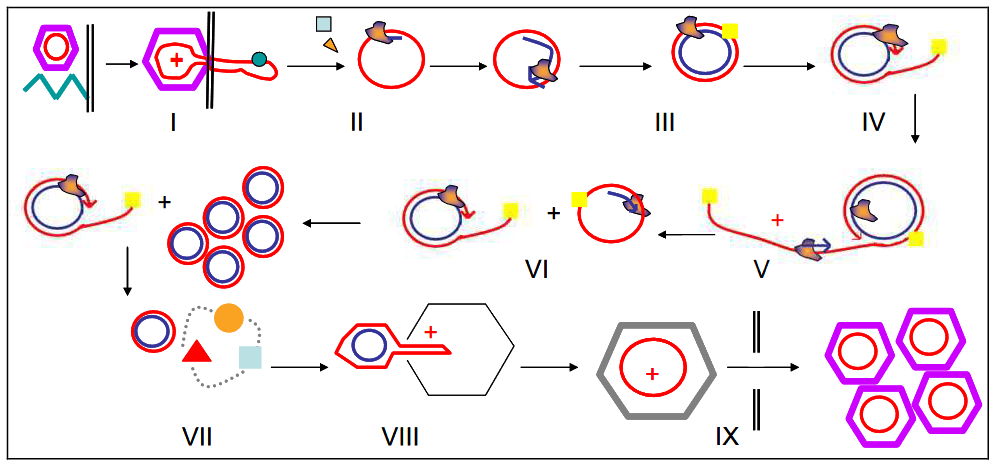

Un système de reconnaissance alimenté par IA “Perception” et “AlexNet”

Comment les robots voient-ils ? Pourquoi est-il important que les robots puissent percevoir leur environnement ? Comment l’intelligence artificielle et l’apprentissage automatique sont-ils exploités pour une vision par ordinateur plus précise ? Nous avons discuté avec l’ingénieur de chez Perception et son l’ingénieur en apprentissage automatique pour explorer le sujet complexe de la perception des robots.

Selon lui, “La perception consiste à analyser les données sensorielles que le robot reçoit et à produire des informations utiles pour les tâches en aval.” Dans le cas de Digit, ces “tâches en aval” pourraient être la manipulation de bacs, l’évitement d’obstacles ou simplement savoir où placer ses pieds. Et à mesure que la plateforme se développe, de plus en plus de tâches devront utiliser des données de perception.

Créer des robots généralisés ou polyvalents est une chose impossible sans qu’ils puissent percevoir activement et comprendre l’environnement qui les entoure. Mais quelque chose qui est naturel pour les humains représente un défi monumental pour les robots.

Regardez cette image. Vous l’avez probablement presque instantanément reconnue comme un cube de brocoli congelé sans même y penser, mais cette tâche pourrait s’avérer assez confuse pour un algorithme de vision par ordinateur. La plupart des gens tiennent probablement pour acquis à quelle vitesse et avec quelle précision leurs yeux détectent ce qui est devant eux, même dans de nouveaux scénarios.

Le travail de perception que réalise la société Agility se distingue des autres applications de vision par ordinateur. Ces algorithmes de perception doivent fonctionner pour Digit, une plateforme physique et mobile conçue pour être dans le monde réel et accomplir un travail concret. De plus, ils doivent fonctionner en temps réel.

“Digit est une plateforme mobile, et c’est une interaction en temps réel avec l’environnement” Avec des caméras statiques, vous pouvez revenir en arrière et rejouer des images. Elles n’ont pas de flou de mouvement. Vous pouvez vraiment contrôler votre environnement. Mais avec Digit qui se déplace, les effets de la détection du premier élément affectent également tout ce qui suit.

Cela devient extrêmement important lors de la résolution de défis tels que la locomotion. La qualité d’une carte de terrain peut faire la différence entre une démarche équilibrée et stable ou une chute au sol. Les mêmes défis s’appliquent à l’évitement d’obstacles et à la détection d’objets. De plus, la difficulté de ces tâches est accrue lorsqu’on prend en compte l’imprévisibilité et l’aléatoire du monde.

“L’un des grands défis que nous avons au sein de l’équipe de perception est la robustesse, en particulier face à de nouveaux scénarios que nous n’avons pas encore rencontrés”.

Sans surprise, l’un des outils les plus puissants pour relever ces défis est l’apprentissage automatique.

“On peut faire de la vision sans IA” On peut faire des choses comme la reconnaissance d’objets. Il existe des algorithmes traditionnels pour cela. Mais depuis la sortie d’AlexNet, il bat tous les autres modèles traditionnels sur cette grande base de données appelée ImageNet. Donc, il n’y a vraiment pas de meilleur outil à utiliser.

AlexNet est un système de réseau neuronal convolutionnel : un système informatique qui traite les données de manière à imiter le cerveau humain. Conçu par Alex Krizhevsky, AlexNet excelle dans la détection d’objets. Et lorsqu’on utilise l’apprentissage automatique et les réseaux neuronaux, il y a une ressource valorisée par-dessus tout.

“Les données sont la chose la plus importante en intelligence artificielle”. Sans de bonnes données, nous ne pouvons pas construire une bonne IA. Donc, aller collecter de plus en plus de données à mesure que nous nous rendons dans des environnements de plus en plus variés nous aidera à devenir encore meilleurs dans la création de ce modèle de base général. Il est a souligner l’importance de défier continuellement les modèles de Perception avec des données nouvelles et variées.

“Si nous recueillons beaucoup de données d’entraînement pour le modèle d’apprentissage automatique dans un environnement spécifique, puis que nous le déployons dans un environnement différent, cela commencera à mettre à l’épreuve nos algorithmes de perception”. C’est pourquoi il est crucial de donner aux modèles autant de pratique que possible, même lorsque cela devient un scénario improbable ou irréaliste.

Actuellement, les algorithmes de perception nécessitent beaucoup d’intervention et de maintenance humaines, et ils sont principalement adaptés à des tâches spécifiques. Les ingénieurs doivent filtrer manuellement les données d’entraînement pour aider à enseigner au modèle ce qui est quoi. Mais le monde n’est pas prévisible et n’est pas facile à modéliser. Il est plein d’aléas et d’incertitudes. Ainsi, les robots à usage général devront être capables de s’adapter en temps réel.

“Au lieu de développer un algorithme de perception pour s’exécuter une fois sur un ensemble de données, vous voulez développer un algorithme qui soit robuste face à des scénarios non prévus”. Une chose à laquelle nous pensons constamment est d’identifier les cas où l’algorithme de perception échoue pour filtrer cette information vers les ingénieurs, et ensuite nous pouvons concevoir différentes solutions algorithmiques pour cela.

L’objectif est qu’un jour, les robots puissent le faire eux-mêmes, en utilisant leurs systèmes embarqués pour détecter les défaillances et mettre à jour l’algorithme en conséquence.

Nous avons tellement de complexité, tant de choses qui entrent en jeu, nous voulons qu’il soit capable d’interagir avec toutes ces choses et de les gérer de manière dynamique, de gérer les personnes et les situations dans des endroits totalement inconnus, et de continuer à faire son travail en toute sécurité.

/// Système PERCEPTION avec AlexNet pour la reconnaissance d’objets ///

Axel Louineaux

Annonces PARTENAIRES

Centre de formation CFA - Certifié Qualiopi Diplômes RNCP et certifications RS.

3axes academy : Formation, Innovation, Excellence

VOIR NOS FORMATIONSOffrez-vous cette emplacement publicitaire